USB-technologie begrijpen voorbij de marketing

Continue analyse van flashgeheugen, USB-technologie en gegevensbeveiliging - helder uitgelegd voor wie echt wil begrijpen wat er gebeurt.

Kernkennisgebieden

Flash-opslag

Hoe NAND werkt, mythen over levensduur, prestatiegedrag en prijstrends.

USB-beveiliging

Kopieerbeveiliging, risico's op datalekken, schrijfbeveiliging en compliancerealiteit.

Data-integriteit

Testtools, usb-sticks met valse capaciteit, corruptieproblemen en verificatiemethoden.

USB-hardware

Wat zit er in een usb-stick, firmwaregedrag en prestatie-afwegingen.

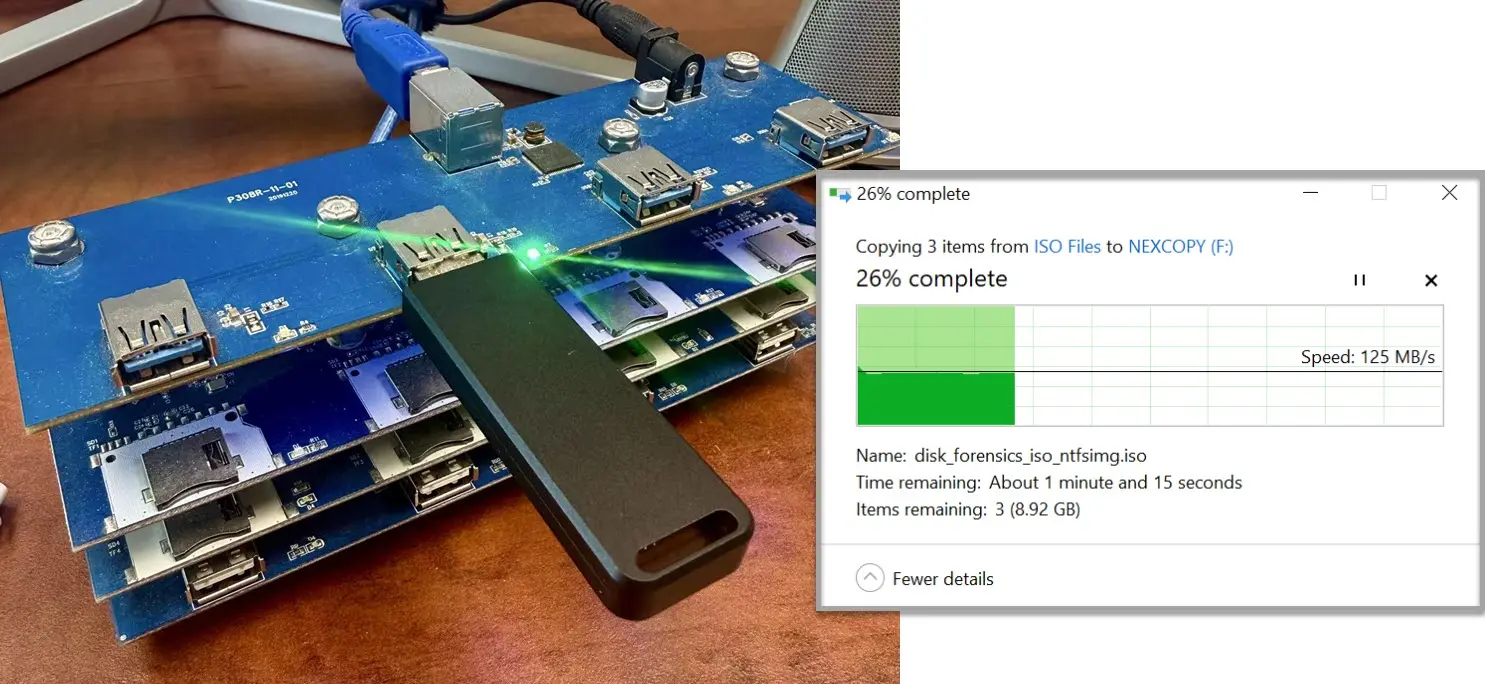

Duplicatiesystemen

Kopiëren bij massaproductie, verificatiemethoden en workflow-ontwerp.

Sectoranalyse

Marktverschuivingen, aanbodbeperkingen, AI-vraag en prijsdynamiek van flashgeheugen.

Uitgelichte analyse

Diepgaande duiken in realistisch USB-gedrag, de economie achter flashgeheugen, controllerkeuzes en beveiligingsafwegingen.

Nieuwste artikelen

Als USB-C zo goed is, waarom gebruiken tv’s dan nog steeds HDMI?

Als we geen water door Californië kunnen verplaatsen, hoe bouwen we dan steden op Mars?

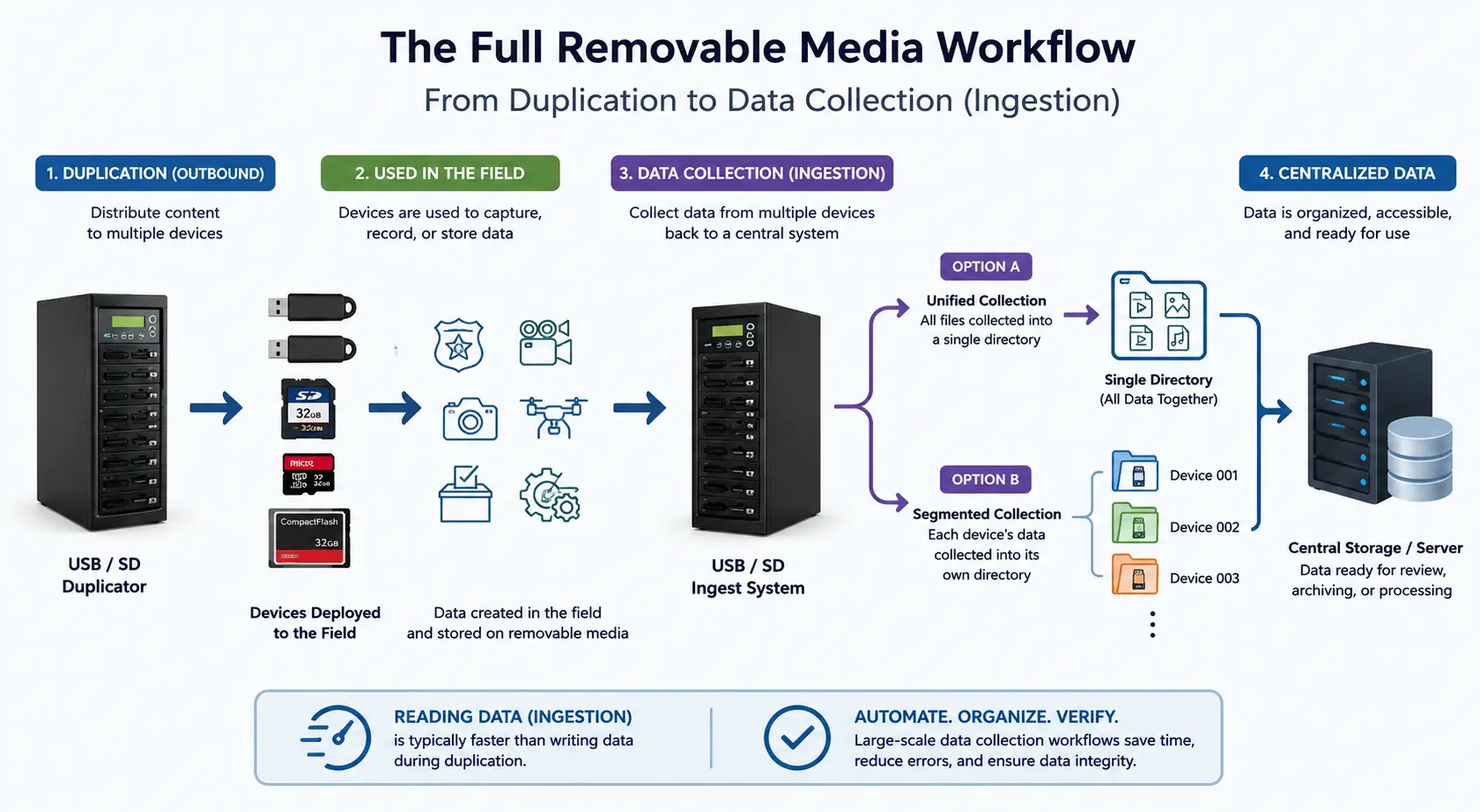

De over het hoofd geziene kant van verwisselbare media: workflows voor grootschalige gegevensverzameling

KV Cache: het AI-geheugenreservoir dat voorkomt dat GPU’s drooglopen

Mara Vale: De air-gapped echo | Cyberpunk noir over onzichtbare signalen en datalekken