Flashgeheugen bewaart alles – behalve zijn eigen geschiedenis

Flashgeheugen bewaart de data van de hele wereld – maar niet zijn eigen verhaal

Als je op zoek gaat naar een museum dat volledig aan flashgeheugen is gewijd, kom je verrassend weinig tegen. Er is er één – weggestopt in een opslagfaciliteit in China, deels showroom, deels historische tentoonstelling – maar het is niet iets wat het publiek bezoekt, en het probeert ook geen permanent archief te zijn. Het is eerder een zorgvuldig samengestelde herinnering dat deze technologie überhaupt een verleden heeft.

Dat is een vreemde positie voor iets wat stilletjes het grootste deel van de data van de wereld bewaart.

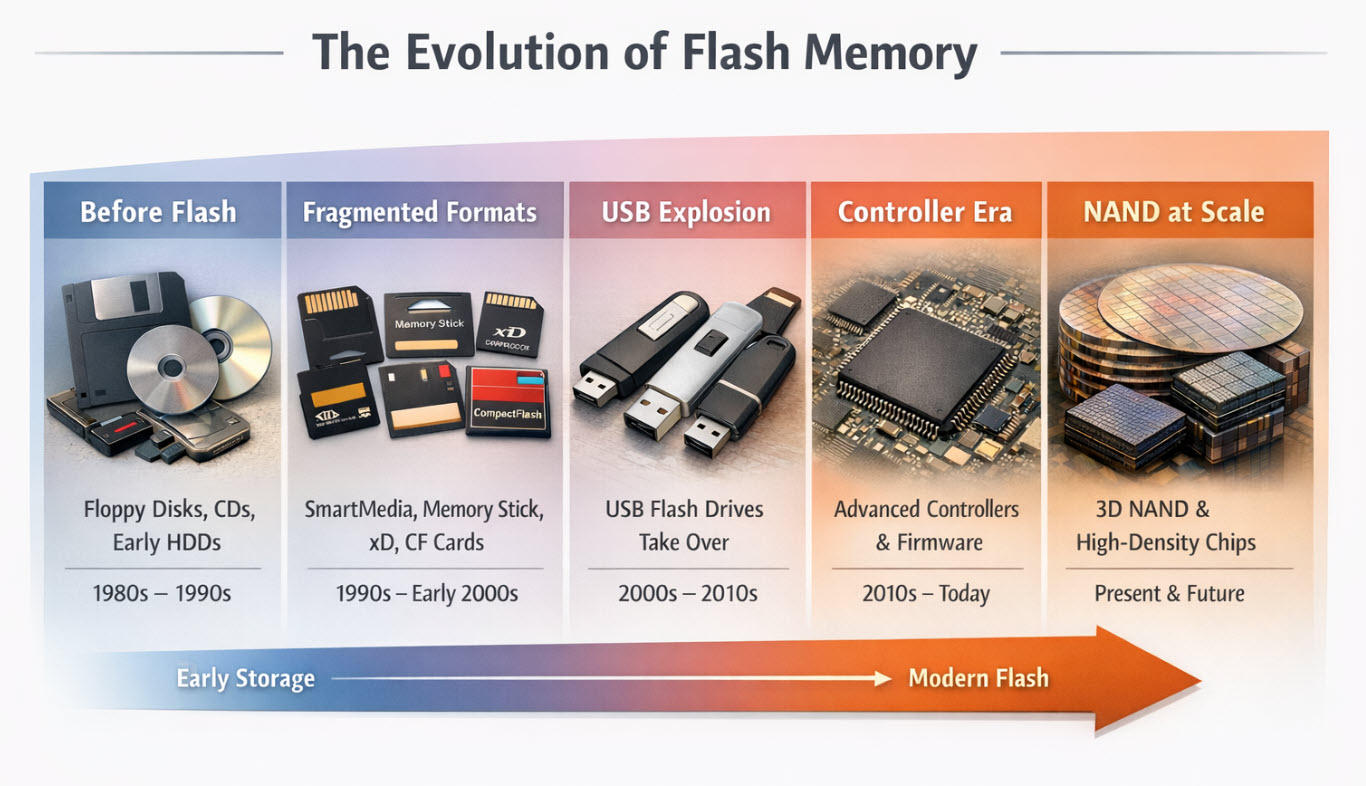

Flashgeheugen zit tegenwoordig onder alles – USB-sticks, SD-kaarten, SSD’s, embedded systemen – en toch is er bijna geen fysiek spoor van hoe het zich heeft ontwikkeld. Geen centraal archief. Geen breed erkende collectie. Geen plek waar je door de ontwikkeling kunt lopen van vroege verwisselbare kaartjes tot de controller-gestuurde opslagsystemen waar we vandaag op vertrouwen. Voor een technologie die zó belangrijk is, valt die afwezigheid moeilijk te negeren zodra je er eenmaal naar gaat zoeken. Als je eerst een stap terug wilt doen en de basis wilt begrijpen van hoe data over dit soort apparaten wordt opgeslagen, is het de moeite waard om te kijken naar hoe we bestanden opslaan op een USB-stick of USB-harde schijf voordat je dieper in de architectuur duikt.

En hoe langer je erover nadenkt, hoe ongemakkelijker het wordt. Want dit is niet alleen een gat in de manier waarop we bewaren – het is ook een structureel probleem van de technologie zelf. Flashgeheugen is erg goed in het opslaan van data, maar het blijkt niet erg goed te zijn in het bewaren van zijn eigen geschiedenis.

In het midden van dit alles staat NAND-flash – de kerntechnologie achter bijna elk modern opslagapparaat. Het is niet zomaar een onderdeel van het gesprek op dit moment, het is het gesprek. Beperkingen in de toelevering, schaalbaarheidsgrenzen, complexere controllers, vraag vanuit enterprise-omgevingen – NAND duikt op in sectorrapporten, kwartaalcijfers en infrastructuurplannen op een manier die tien jaar geleden nauwelijks bestond. En als je wilt zien hoe dat gesprek nu verdergaat, helpt het om ook te kijken naar hoe MLC en TLC NAND vandaag anders worden beoordeeld.

En die druk neemt niet af. Integendeel, die versnelt juist.

De opkomst van kunstmatige intelligentie – en vooral de verschuiving van de huidige grootschalige modellen naar wat velen Artificial General Intelligence (AGI) noemen – drijft een compleet nieuwe categorie van datavraag aan. AGI verwijst, simpel gezegd, naar systemen die op menselijk niveau kunnen redeneren, leren en zich aanpassen over een breed scala aan taken, in plaats van beperkt te blijven tot smalle, gespecialiseerde functies. Of die tijdlijn nu snel werkelijkheid wordt of niet, de richting is duidelijk: meer modellen, meer data, meer checkpoints, meer opslaglagen die steeds complexere systemen voeden. Dat bredere geheugenvraagstuk zie je ook terug in de rol van HBM binnen moderne AI-systemen.

Flashgeheugen zit precies in het midden van die pijplijn.

Trainingsdatasets, modelgewichten, inference-caching, edge deployment – dit zijn geen theoretische workloads. Ze gebeuren nu al, en ze hangen allemaal af van snelle, dichte en betrouwbare opslag. NAND is niet alleen fundamenteel geworden voor consumentenapparaten, maar ook voor de infrastructuur die de volgende fase van computing vormgeeft.

En dat maakt de situatie alleen maar vreemder.

Precies op het moment dat flashgeheugen een van de meest kritieke technologieën ter wereld wordt, blijft het ook een van de minst goed bewaarde.

Dus stel dat er echt een volwaardig flashgeheugenmuseum zou bestaan – iets groters dan een kleine bedrijfsexpositie – wat zou je daar dan eigenlijk zien?

Een wandeling door een flashgeheugenmuseum

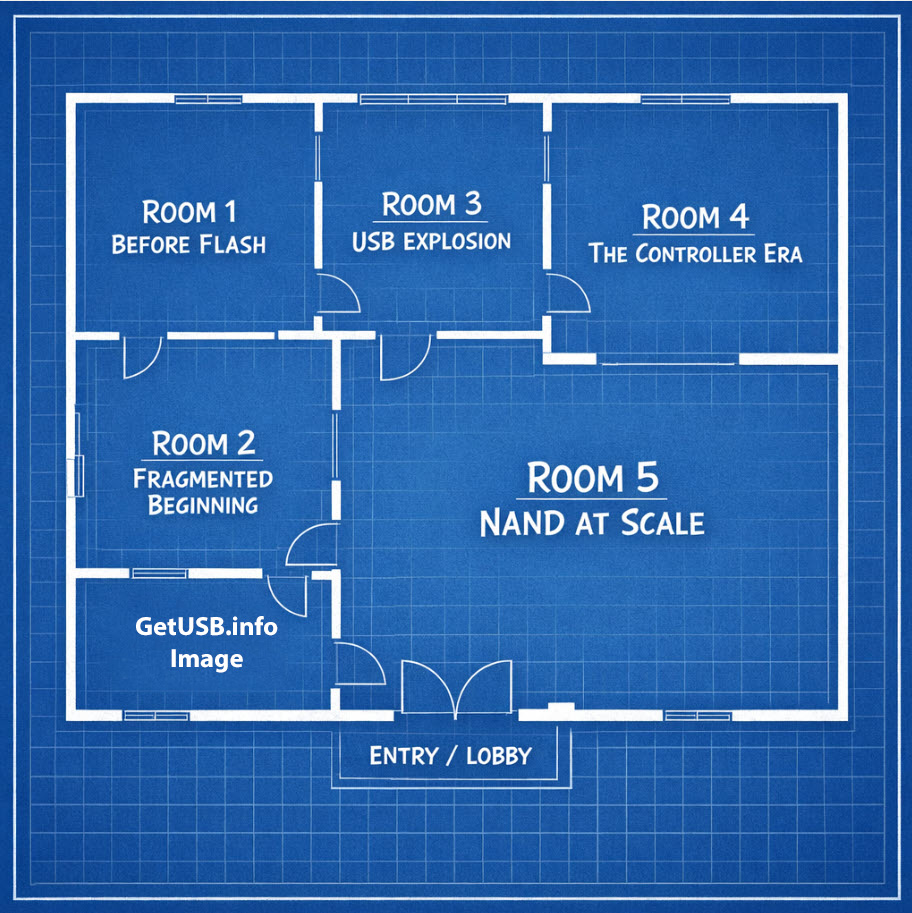

Als er echt een flashgeheugenmuseum zou bestaan, zou het niet aanvoelen als een tijdlijn aan de muur met data en productlanceringen. Het zou eerder voelen als een wandeling door de lagen van hoe opslag werkelijk werkt, waarbij elke ruimte groter of kleiner wordt afhankelijk van hoeveel die laag daadwerkelijk bijdraagt aan het uiteindelijke apparaat.

Niet alle onderdelen van flashopslag dragen even zwaar. Sommige zijn zichtbaar maar eenvoudig. Andere zijn volledig verborgen en dragen het grootste deel van de kosten, het risico en de technische inspanning. Als je dat fysiek zou uittekenen, zouden de verhoudingen een heel ander verhaal vertellen dan de meeste mensen verwachten.

De plattegrond van het museum die het echte verhaal vertelt

Ruimte 1 – Voor flash (kleine ruimte – ~5%)

Je zou beginnen in een kleinere ruimte, bijna makkelijk over het hoofd te zien als je niet goed oplet.

Floppydisks, optische media, misschien een paar vroege harde schijven. Fysieke opslag die je kunt oppakken, bekijken en begrijpen zonder veel uitleg. Data had een plek waar je letterlijk naar kon wijzen. Als iets faalde, faalde het meestal op een manier die je kon zien of horen.

Daar zit iets geruststellends in.

Deze ruimte is belangrijk omdat ze de basis neerzet. Ze herinnert je eraan dat opslag ooit tastbaar was en in veel gevallen verrassend duurzaam, zolang je er goed mee omging. Maar als het gaat om hoe moderne flashapparaten worden gebouwd en waar de kosten zitten, neemt dit deel van het verhaal vandaag nog maar weinig ruimte in. Het is context, geen bijdrage.

Ruimte 2 – Het versnipperde begin (middelgrote ruimte – ~10-15%)

De volgende ruimte wordt wat voller, en ook wat minder ordelijk.

Je begint SmartMedia-kaarten, Memory Stick, xD-Picture Card en CompactFlash te zien – formaten die bekend aanvoelen als je lang genoeg meeloopt, maar ook een beetje los van elkaar staan. Verschillende vormen, verschillende connectors, verschillende aannames over hoe het geheugen zou worden gebruikt.

Op het eerste gezicht lijkt het op een simpele formaatstrijd, maar dat is niet echt wat er gebeurde. Onder die vormfactoren zaten echte beperkingen die samenhingen met controllercapaciteit, NAND-dichtheid en de manier waarop data betrouwbaar kon worden beheerd. Sommige formaten liepen vroeg tegen schaalbaarheidsmuren aan. Andere waren te strak gecontroleerd om brede adoptie te krijgen. Een paar werden gewoon te duur om te rechtvaardigen zodra betere opties verschenen.

Ze verdwenen niet omdat mensen ze niet meer leuk vonden. Ze verdwenen omdat ze het tempo niet konden bijhouden.

Deze ruimte neemt meer plaats in omdat ze een periode vertegenwoordigt waarin de industrie nog aan het uitzoeken was hoe alles moest werken, en dat proces was niet goedkoop. Er zit veel techniek verborgen in de formaten die het niet hebben overleefd.

Ruimte 3 – De USB-explosie (grote ruimte – ~20-25%)

Daarna loop je een ruimte binnen die merkbaar open aanvoelt.

Dit is het moment waarop USB-sticks het overnemen en alles meer één geheel begint te worden. De vormen worden eenvoudiger, de interfaces standaardiseren, en het idee van draagbare opslag verandert van een nichetoepassing in iets wat bijna vanzelfsprekend wordt.

Wat interessant is, is dat hoewel alles aan de buitenkant eenvoudiger lijkt, de binnenkant hier juist ingewikkelder begint te worden. Controllers worden capabeler, NAND wordt dichter verpakt, en de productie schaalt op een manier waardoor flash een commodity wordt.

Dit is ook het moment waarop flash naar de achtergrond verdwijnt. Het is niet langer hét kenmerk – het is er gewoon, en doet zijn werk. Mensen stoppen met nadenken over hoe het werkt en gaan er gewoon van uit dat het er altijd zal zijn wanneer ze het nodig hebben.

Vanuit kostenoogpunt is deze ruimte fors, omdat ze de verschuiving naar massaproductie en wereldwijde adoptie weerspiegelt. Hier wordt flash onderdeel van alledaags computergebruik in plaats van iets wat je bewust moest gaan kopen.

Ruimte 4 – Het controller-tijdperk (grootste ruimte – ~30-40%)

Op een bepaald moment stap je de grootste ruimte binnen, en als je flashgeheugen daarvoor nog niet echt begreep, dan is dit het punt waarop dingen beginnen te landen.

Want hier gebeurt het echte werk.

Je ziet in deze ruimte niet alleen chips – je ziet de logica erachter. De controller, de firmware, de mapping tussen wat het systeem denkt te schrijven en wat de NAND in werkelijkheid aankan. Het is het deel van het systeem dat de meeste mensen nooit zien, maar het is voortdurend bezig met vertalen, corrigeren en beslissingen nemen op de achtergrond.

Wat je moet begrijpen, is dat ruwe NAND op zichzelf niet bijzonder betrouwbaar is. Cellen slijten, bits driften, blokken gaan kapot. Zonder beheer zou het niet lang bruikbaar blijven. De controller is wat dat instabiele medium omzet in iets dat zich gedraagt als stabiele opslag.

Die bepaalt waar data terechtkomt, hoe lang die daar blijft, wanneer die moet worden verplaatst, en hoe fouten onderweg worden afgehandeld. Het is ook de plek waar twee apparaten die op papier identiek lijken, zich in de praktijk heel verschillend kunnen gedragen.

Deze ruimte is groot omdat de kosten groot zijn – niet alleen in componenten, maar ook in ontwikkeling, validatie en betrouwbaarheid op lange termijn. Veel van wat het ene opslagproduct beter maakt dan het andere, leeft hier, ook al verschijnt het nooit op een specificatieblad.

Ruimte 5 – NAND op schaal (enorme ruimte – ~40-50%)

En dan kom je in de laatste ruimte, en die is allesbehalve subtiel.

Deze ruimte wordt gedomineerd door de fysieke realiteit van NAND zelf. Wafers, gestapelde lagen, steeds dichtere celstructuren die tot vlak tegen hun grenzen worden opgevoerd. Hier zit het grootste deel van de kosten, en dat zie je ook.

Wat in deze ruimte duidelijk wordt, is dat alles eromheen bestaat om te ondersteunen wat hier gebeurt. Naarmate NAND dichter wordt, wordt het ook kwetsbaarder. Foutpercentages lopen op. Dataretentie wordt lastiger. De foutmarge wordt kleiner.

Daardoor moet de controller harder werken. De firmware moet meer compenseren. Het hele systeem wordt een evenwichtsoefening tussen dichtheid, prestaties en betrouwbaarheid.

Dit is ook waar het huidige moment scherp in beeld komt. Enterprise-opslag, datacenters, AI-workloads – alles hangt ervan af dat NAND verder wordt opgerekt en zich toch voorspelbaar blijft gedragen.

En dat wordt moeilijker, niet makkelijker.

Wat die ruimtes je eigenlijk vertellen

Als je een stap terug doet en naar de volledige indeling kijkt, vertellen de verhoudingen een verhaal dat de meeste mensen niet verwachten.

De onderdelen waarmee je direct te maken hebt – de connector, de vormfactor, zelfs het merk – nemen relatief weinig ruimte in. Het grootste deel van het systeem leeft op plekken die je niet ziet, aangedreven door fysieke grenzen en de logica die nodig is om daar omheen te werken.

En dat is precies wat het idee van het bewaren van flashgeheugen zo ingewikkeld maakt.

Je kunt apparaten achter glas zetten. Je kunt formaten en tijdlijnen labelen. Maar de belangrijkste onderdelen – het gedrag van de controller, de beslissingen in de firmware, de manier waarop data door de tijd heen wordt beheerd – blijven in traditionele zin niet lang genoeg stilzitten om echt te bewaren.

Ze ontwikkelen zich, worden vervangen, en verdwijnen uiteindelijk samen met de hardware die ervan afhankelijk was.

En dat maakt het idee van een flashgeheugenmuseum, als je er goed over nadenkt, toch een beetje vreemd.

Want zelfs als je er één zou bouwen, zouden de belangrijkste onderdelen niet het makkelijkst zijn om te behouden.

Auteur & transparantie over de inhoud

Dit artikel begon met een eenvoudige observatie van de auteur: voor een technologie die bijna alle moderne data bewaart, heeft flashgeheugen nauwelijks een formeel archief of een openbaar verslag van zijn eigen ontwikkeling. Het concept, de richting en het technische perspectief komen voort uit jarenlange praktijkervaring met USB-opslagsystemen, gedrag op controllerniveau en de inzet van flashgeheugen in commerciële en industriële omgevingen.

De auteur is sinds 2004 actief in de wereld van USB en flashgeheugen, en heeft van dichtbij gezien hoe opslagapparaten zich hebben ontwikkeld – van vroege verwisselbare formaten tot moderne controller-gestuurde systemen. Terugkijkend is het niet onredelijk om te zeggen dat, als de sector had ingezien hoeveel er níet bewaard zou blijven, iemand jaren geleden al een serieus archief of museum had kunnen beginnen. In plaats daarvan is veel van die geschiedenis verspreid geraakt, vervangen of stilletjes verloren gegaan terwijl elke nieuwe generatie technologie verder schoof.

AI-tools zijn gebruikt bij het maken van dit artikel om te helpen met structuur, flow en algemene leesbaarheid. Alle kernideeën, technische inzichten en conclusies zijn echter door de auteur ontwikkeld en beoordeeld om nauwkeurigheid en relevantie te waarborgen.

De afbeeldingen in dit artikel zijn geen stockfoto’s. Het zijn visuele representaties die met behulp van AI-tools zijn gemaakt op basis van de scenario’s en concepten die in de inhoud worden beschreven. Deze beelden zijn bedoeld om ideeën te illustreren die lastig vast te leggen zijn met traditionele fotografie, vooral wanneer het gaat om interne componenten, historische formaten of abstract systeemgedrag.

Labels:architectuur van flashgeheugen, dataopslagsystemen, evolutie van USB-opslag, geschiedenis van flashgeheugen, NAND-technologie