Wat is High Bandwidth Memory (HBM) en waarom AI ervan afhankelijk is

AI-systemen vertragen meestal niet door beperkingen in rekenkracht, maar omdat het systeem de data niet snel genoeg kan verplaatsen om de processor continu van informatie te voorzien.

Met andere woorden: de bottleneck zit niet in het verwerken van data, maar in het leveren van die data op de snelheid die moderne AI-workloads vereisen.

Daar komt High Bandwidth Memory (HBM) in beeld als een belangrijk onderdeel van de architectuur.

Voor een breder beeld van hoe geheugen zich ontwikkelt voorbij flash en waarom AI-systemen tegenwoordig afhankelijk zijn van meerdere lagen, zie onze hoofdanalyse: NAND verdwijnt niet, maar AI-servers zijn tegenwoordig afhankelijk van meer dan alleen flash.

Wat is High Bandwidth Memory (HBM)?

High Bandwidth Memory is een type gestapelde DRAM dat extreem dicht bij de processor wordt geplaatst, vaak slechts millimeters van de GPU-die verwijderd, om de fysieke afstand die data moet afleggen tot een minimum te beperken.

In tegenstelling tot traditioneel systeemgeheugen, dat afhankelijk is van langere elektrische paden en smallere datakanalen, is HBM ontworpen rond nabijheid en parallelisme, waardoor aanzienlijk meer data tegelijk kan worden verplaatst met veel minder vertraging.

- Brede geheugenbussen, vaak duizenden bits breed

- Ultrakorte verbindingen tussen geheugen en processor

- Massaal parallelle toegang tot data

Het doel is simpel: de afstand verkleinen tussen waar data wordt opgeslagen en waar het wordt verwerkt, want in high-performance systemen stapelen zelfs kleine vertragingen zich snel op.

In de praktijk betekent afstand direct meer latentie, en latentie is een van de belangrijkste factoren die de prestaties van AI beperken.

Een eenvoudige manier om HBM te begrijpen

Een handige manier om dit te visualiseren is door een traditioneel systeem te zien als een fabriek die via een snelweg verbonden is met een magazijn.

Elke keer dat de fabriek onderdelen nodig heeft, moeten die heen en weer worden vervoerd, wat vertraging veroorzaakt, het energieverbruik verhoogt en de snelheid van het systeem beperkt.

HBM verandert deze relatie door het magazijn als het ware direct bovenop de fabrieksvloer te stapelen.

In plaats van afhankelijk te zijn van transport, is alles direct toegankelijk, waardoor de vertragingen die ontstaan door langere afstanden verdwijnen.

Dat is in feite wat HBM doet voor een GPU: het plaatst het geheugen zo dicht bij de rekenkern dat dataverplaatsing bijna direct gebeurt in vergelijking met traditionele ontwerpen.

Hoe HBM fysiek is opgebouwd

Het voordeel van HBM zit niet alleen in de layout, maar ook in hoe het geheugen zelf op siliciumniveau is opgebouwd.

HBM wordt gemaakt door meerdere DRAM-dies verticaal te stapelen en ze te verbinden met Through-Silicon Vias (TSV’s), microscopisch kleine verticale verbindingen die door het silicium worden geboord om directe elektrische verbindingen tussen de lagen mogelijk te maken.

Deze gestapelde geheugenmodules worden vervolgens samen met de GPU op een interposer geplaatst, waardoor een strak geïntegreerd pakket ontstaat waarin geheugen en rekenkracht functioneren als één systeem in plaats van als losse componenten.

Het resultaat is een combinatie van extreem brede datapaden en zeer korte elektrische afstanden, die samen de hoge bandbreedte mogelijk maken die HBM definieert.

Waarom AI afhankelijk is van HBM

AI-workloads, vooral bij het trainen van modellen, vereisen een continue verplaatsing van grote hoeveelheden data, vaak met miljarden of zelfs biljoenen parameters die steeds opnieuw gelezen, bijgewerkt en herschreven moeten worden.

Dit creëert een behoefte aan zowel hoge bandbreedte om grote datasets snel te verplaatsen, als lage latentie om ervoor te zorgen dat de rekenkernen niet stilvallen terwijl ze wachten op data.

- Hoge bandbreedte zorgt ervoor dat grote hoeveelheden data snel kunnen worden overgedragen

- Lage latentie zorgt ervoor dat de compute-eenheden volledig benut blijven

Traditionele geheugenarchitecturen hebben moeite om aan beide eisen tegelijk te voldoen, en daarom is HBM een standaardcomponent geworden in high-end AI-accelerators.

Zonder HBM zou zelfs de krachtigste GPU een groot deel van de tijd wachten op data in plaats van deze te verwerken.

De afweging: snelheid versus kosten

Hoewel HBM aanzienlijke prestatievoordelen biedt, brengt het ook extra complexiteit en kosten met zich mee door het gestapelde ontwerp en de geavanceerde packaging-eisen.

Het gebruik van meerdere DRAM-lagen, precieze interconnects en interposer-integratie maakt HBM tot een van de duurdere geheugentechnologieën die momenteel beschikbaar zijn.

Daarom wordt het meestal ingezet in toepassingen waar prestaties cruciaal zijn en de kosten te rechtvaardigen zijn, zoals AI-training en high-performance computing.

Algemene systemen, waar kosten een grotere rol spelen, blijven vertrouwen op meer conventionele geheugenoplossingen.

Waar HBM in het grotere geheel past

HBM vervangt andere soorten geheugen niet, maar bevindt zich bovenaan in een gelaagde geheugenhiërarchie, waarbij elke laag is geoptimaliseerd voor een andere balans tussen snelheid, kosten en capaciteit.

| Technologie | Typische latentie | Bandbreedte | Kosten per GB | Primaire rol |

|---|---|---|---|---|

| HBM (gestapelde DRAM) | Nanoseconden | Terabytes/sec | Zeer hoog | AI-trainingsgeheugen |

| DDR DRAM | ~100ns | Hoog | Hoog | Systeemgeheugen |

| NVMe SSD | Microseconden–milliseconden | Gemiddeld | Laag | Bulkopslag |

Elke laag bestaat vanwege de afwegingen tussen prestaties, kosten en capaciteit, en geen enkele technologie kan alle drie tegelijk optimaliseren.

HBM bevindt zich in de hoogste prestatieklasse, waar snelheid belangrijker is dan kosten, en is daardoor essentieel voor workloads die geen vertraging kunnen tolereren.

De verschuiving

HBM moet niet worden gezien als simpelweg sneller geheugen, maar als een verschuiving in systeemontwerp waarbij geheugen fysiek dichter bij de rekenkracht wordt gebracht om een van de grootste bottlenecks in moderne computing te elimineren.

In AI-systemen, waar prestaties direct afhangen van hoe snel data toegankelijk is en verwerkt kan worden, speelt deze architecturale verandering een cruciale rol.

Uiteindelijk zijn zelfs de meest geavanceerde processors afhankelijk van een constante stroom data, en het verbeteren van die stroom is precies wat technologieën zoals HBM zo belangrijk maakt.

Redactionele en afbeeldingsnotitie: Dit artikel is opgesteld en beoordeeld door GetUSB.info op basis van onze redactionele research en technische kennis van geheugenarchitectuur en opslaghardware.

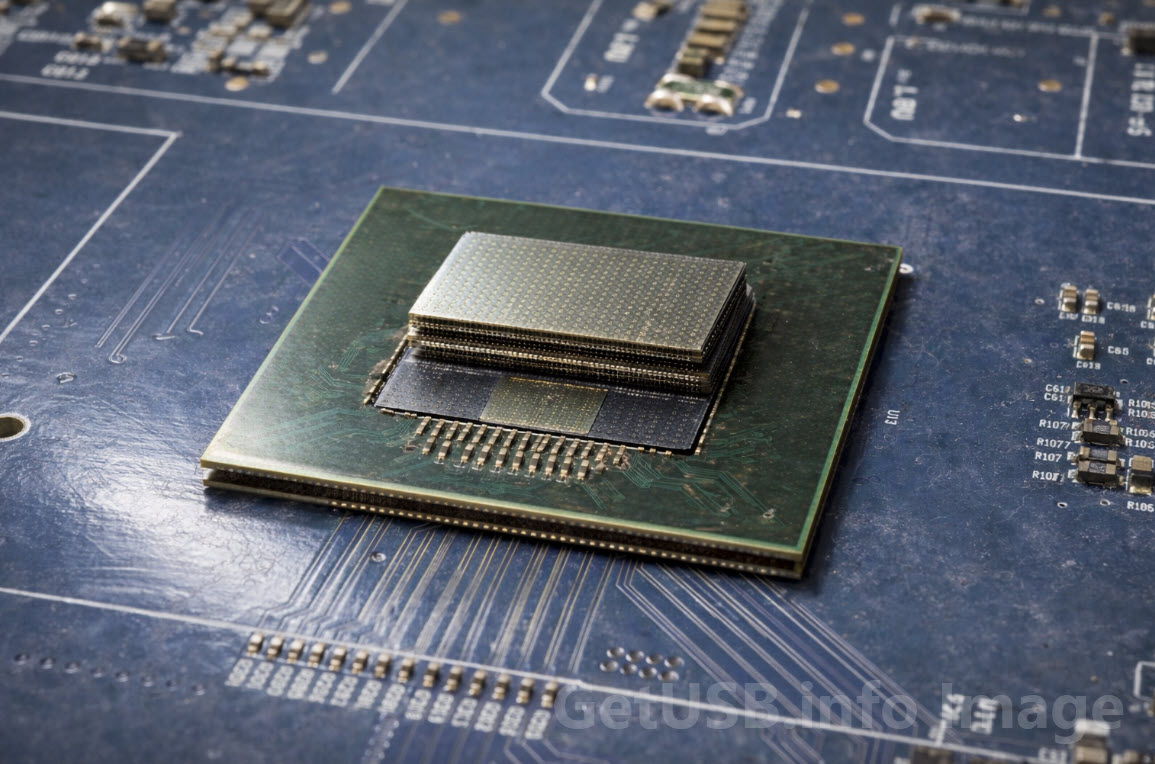

Afbeeldingsinformatie: De afbeelding bij dit artikel is gebaseerd op een echte chipfoto en is aangepast om het HBM-concept duidelijker te maken voor lezers. De aanpassing is puur gedaan voor visuele uitleg en moet worden gezien als een realistische interpretatieve weergave, niet als een letterlijke productiefoto.

Hoe dit artikel tot stand is gekomen: GetUSB.info heeft de richting, technische invalshoek en eindredactie verzorgd. AI-tools zijn gebruikt om ritme en leesbaarheid te ondersteunen, met menselijke controle gedurende het hele proces.

Labels:AI geheugen, AI-infrastructuur, GPU geheugen, HBM, high bandwidth memory